Desarrollan robots para facilitar la autonomía de las personas mayores en sus hogares

También realizarán un 'Observatorio experimental para la vida independiente de Castilla y León'

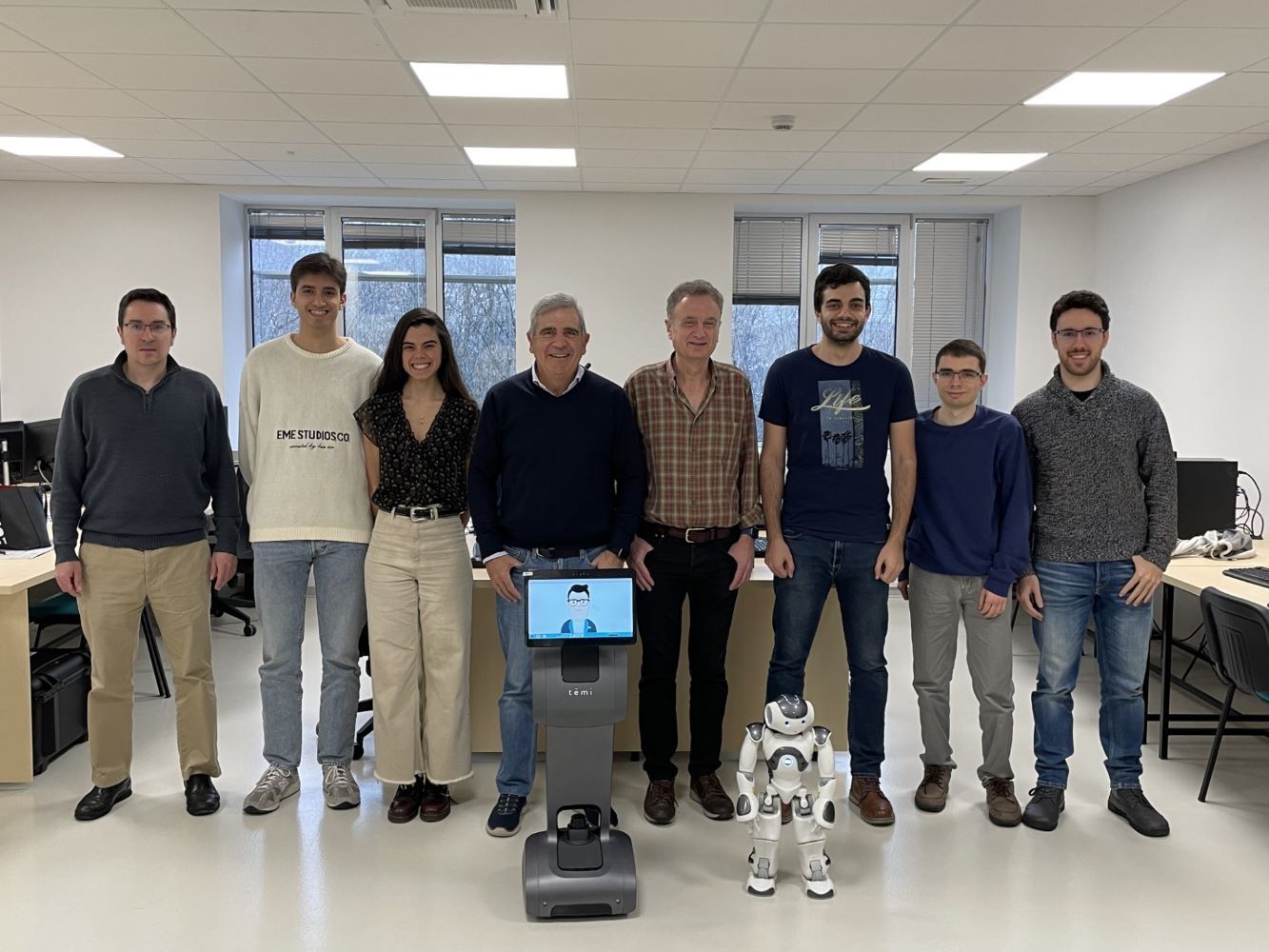

Un equipo de investigadores de la Escuela de Ingenierías Industriales de la Universidad de Valladolid (UVa) ha apostado por el desarrollo de distintos prototipos de robots para facilitar la autonomía de las personas mayores y dependientes en sus hogares.

Lo hacen a través del proyecto EIAROB -Ecosistema de Inteligencia Ambiental para el apoyo de los cuidados en el hogar con robots sociales-, financiado por la Consejería de Familia y Servicios Sociales de la Junta de Castilla y León con fondos Next Generation, y que cuenta con la colaboración del centro tecnológico Cartif, y de las Fundaciones Intras y Asprodes.

Miembros del equipo de investigación del proyecto EIRAB. Foto: Universidad de Valladolid.

Tres ejes estratégicos

Este proyecto, dirigido por el investigador y profesor de la UVa (@UVa_es), Eduardo Zalama, consta de tres ejes estratégicos. El primero de ellos tiene como objetivo desplegar 15 robots en 60 domicilios de la comunidad hasta mediados de 2025, donde los robots funcionarán "de forma autónoma en las casas, pudiendo desplazarse de un sitio a otro" y proporcionando "información sobre el estado y la actividad de la persona, a través de una serie de sensores instalados en el domicilio y en el propio robot", apunta la UVa en un comunicado.

Estos sensores "se comunican a través de un miniordenador con el robot que podrá elaborar con esa información, los patrones de comportamiento en ese domicilio utilizando la inteligencia artificial. Por ejemplo, podrá saber cómo duerme la persona, si se alimenta correctamente, cuánto tiempo ve la televisión, si deambula por las noches, si se ha caído...", explica el investigador, que indica que "también le estamos programando para que, si no detecta actividad y sabe que el usuario no ha salido, haga una ruta por la casa y trate de localizarle. Si detecta alguna de estas situaciones, el robot da el primer nivel de asistencia tratando de verificar cómo se encuentra. Para ello preguntará al residente si se encuentra bien, si no es así, o no hay respuesta, notificará al cuidador la situación".

Por su parte, el cuidador podrá conectarse a un mapa donde aparecerán los domicilios donde estén estos robots, así como realizar otras funciones, como programar la agenda de la persona. Igualmente, este robot será capaz de conectar por videollamada, jugar a juegos y proponer ejercicios físicos u otras actividades, indican.

Por el momento solo hay uno de estos robots desplegado en el domicilio de una persona mayores en Salamanca, y aunque en un principio está pensado para personas que vivan solas, "también podría desplegarse en hogares con más residentes, ya que es capaz de discriminar hasta en un 87% entre las actividades que realiza cada residente, tal y como pudo comprobar uno de los investigadores en su hogar", aseguran.

El segundo eje se centrará en resolver las propias soluciones robóticas del equipo de investigación, para mejorar los desplazamientos de personas mayores o con movilidad reducida. En este sentido, explican que "nuestra idea es hacer un prototipo partiendo desde cero, que pudiéramos fabricar más adelante a través de un spin off intentando abaratar costes, ya que los robots comerciales son muy caros. También, estamos trabajando en el desarrollo de kits de bajo coste para convertir una silla de ruedas manual en eléctrica".

Mientras que el tercer eje será el desarrollo de un Observatorio experimental para la vida independiente de Castilla y León, para evaluar las soluciones actuales que hay en el mercado de la robótica con este objetivo de mejorar la autonomía de estas personas. En este punto también se trabajará para que el robot pueda manipular objetos, a través de la imitación.

El director del proyecto EIAROB explica que "la idea es probar estos robots con usuarios, ver las limitaciones que tienen y buscar posibles soluciones de mejora. Por ejemplo, hemos adquirido un robot que se utiliza para dar de comer a las personas sin movilidad en los brazos. Es un robot que tiene preprogramados una serie de movimientos para dar de comer, pero tiene algunas limitaciones, como son unos pulsadores para decirle que te dé de comer o que cambie de plato, pero si tienes falta de movilidad en los brazos no puedes accionar estos pulsadores".

"Como mejora estamos realizando unos sistemas de control mentoniano que monitoricen la cabeza por visión artificial mediante gestos, por ejemplo, que cuando la persona abra la boca el robot sea capaz de interpretar que quiere comer, y lo contrario", añade.